深入理解 Nvidia-docker2.0

NVIDIA于2016年开始设计NVIDIA-Docker已便于容器使用NVIDIA GPUs。 第一代nvidia-docker1.0实现了对docker client的封装,并在容器启动时,将必要的GPU device和libraries挂载到容器中。但是这种设计的方式高度的与docker运行时耦合,缺乏灵活性。存在的缺陷具体如下:

- 设计高度与docker耦合,不支持其它的容器运行时。如: LXC, CRI-O及未来可能会增加的容器运行时。

- 不能更好的利用docker生态的其它工具。如: docker compose。

- 不能将GPU作为调度系统的一种资源来进行灵活的调度。

- 完善容器运行时对GPU的支持。如: 自动的获取用户层面的

NVIDIA Driver libraries,NVIDIA kernel modules,device ordering等。

基于上面描述的这些弊端,NVIDIA开始了对下一代容器运行时的设计: nvidia-docker2.0。

nvidia-docker 2.0 的实现机制

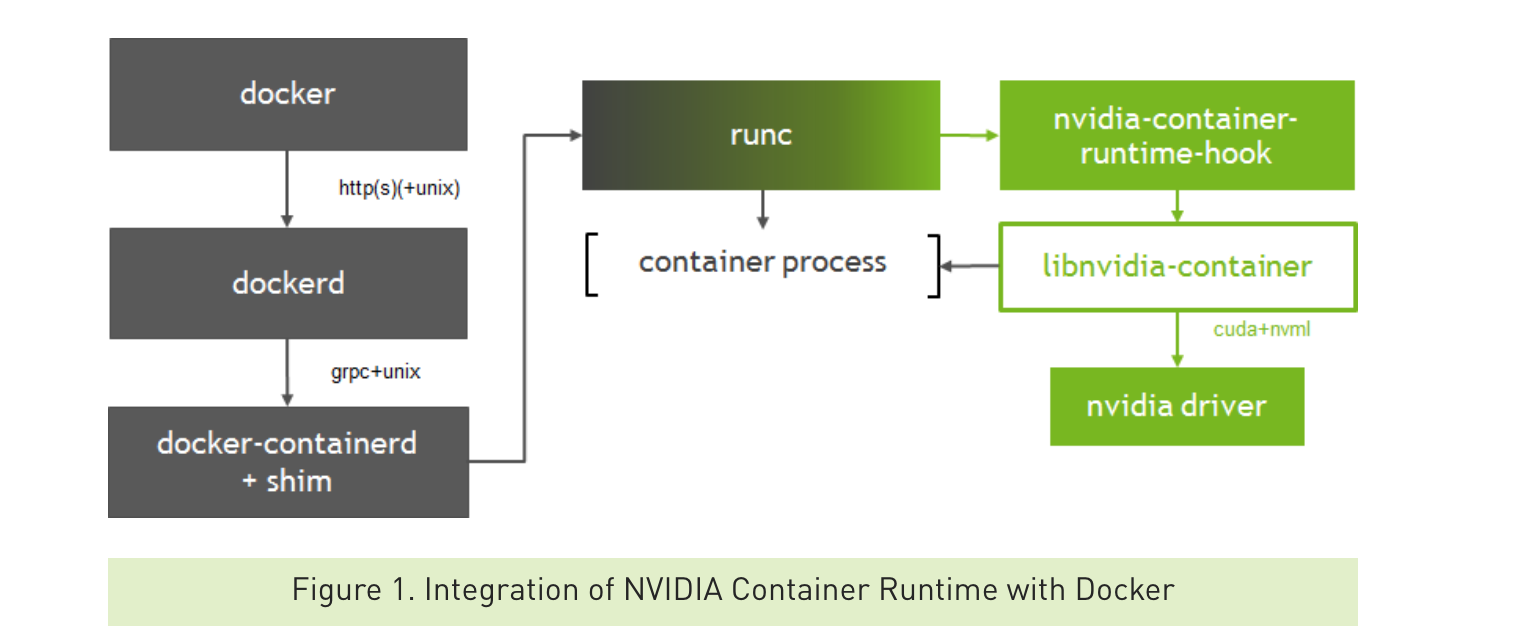

先简单介绍下nvidia-docker 2.0, nvidia-container-runtime,libnvidia-container以及runc直接的关系。

- nvidia-docker2.0 是一个简单的包,它主要通过修改docker的配置文件

/etc/docker/daemon.json来让docker使用NVIDIA Container runtime。 - nvidia-container-runtime 才是真正的核心部分,它在原有的

docker容器运行时runc的基础上增加一个prestart hook,用于调用libnvidia-container库。 - libnvidia-container 提供一个库和一个简单的CLI工具,使用这个库可以使NVIDIA GPU被Linux容器使用。

- runc 一个命令行工具,会根据标准格式的Open Containers Initiative(OCI)创建容器。也是docker默认的容器运行时。

它们之间的关系可以通过下面这张图关联起来:

上面已经介绍个各个组件的作用以及它们之间的关系,接下来详细的描述下这张图:

1.正常创建一个容器的流程是这样的:

1 | docker --> dockerd --> docker-containerd--> docker-containerd-shm -->runc --> container-process |

docker客户端将创建容器的请求发送给dockerd, 当dockerd收到请求任务之后将请求发送给docker-containerd-shm(其实就是containerd)。

前面没有介绍到containerd。这里简单的介绍下,containerd,它主要负责的工作是:

- 管理容器的生命周期(从容器的创建到销毁)

- 拉取/推送容器镜像

- 存储管理(管理镜像及容器数据的存储)

- 调用runc 运行容器

- 管理容器的网络接口及网络

containerd的定位是:

1 | containerd 被设计成嵌入到一个大系统中,而不是给开发人员和终端的设备使用。 |

关于containerd的详细说明,请查看containerd。

当containerd接收到请求之后,做好相关的准备工作,会去调用runc,而runc基于OCI文件对容器进行创建。这是容器创建的整体流程。

2.创建一个使用GPU的容器。

创建GPU容器的流程如下:

1 | docker--> dockerd --> docekr-containerd --> docker-containerd-shim-->nvidia-container-runtime -- > container-process |

基本流程和不使用GPU的容器差不多,只是把docker默认的运行时替换成了NVIDIA自家的nvidia-container-runtime。

这样当nvidia-container-runtime创建容器时,先执行nvidia-container-runtime-hook这个hook去检查容器是否需要使用GPU(通过环境变量NVIDIA_VISIBLE_DEVICES来判断)。如果需要则调用libnvidia-container来暴露GPU给容器使用。否则走默认的runc逻辑。

说到这里nvidia-docker2.0的大体机制基本就通了。但是涉及到的nvidia-container-runtime, libnvidia-container, containerd,runc这些项目, 这本篇文章里面就不一一介绍了。如果感兴趣可以自行去探索学习。这些项目的地址在文章中都已经做个相关的链接。

参考

https://developer.nvidia.com/nvidia-container-runtime

https://devblogs.nvidia.com/gpu-containers-runtime/

https://github.com/opencontainers/runtime-spec/blob/master/config.md

https://github.com/opencontainers/runtime-spec

https://github.com/NVIDIA/nvidia-container-runtime

https://github.com/opencontainers/runc

https://github.com/NVIDIA/libnvidia-container

https://github.com/NVIDIA/nvidia-docker/issues/815